Como estava esse conteúdo?

- Aprenda

- A Articul8 AI preenche a lacuna de experiência industrial com modelos especializados do Llama 4 e a arquitetura AWS que prioriza a segurança

A Articul8 AI preenche a lacuna de experiência industrial com modelos especializados do Llama 4 e a arquitetura AWS que prioriza a segurança

As empresas industriais enfrentam riscos financeiros significativos e atrasos operacionais ao usar modelos de IA gerais que tratam dados técnicos especializados como ruído branco. Essas abordagens têm dificuldade em interpretar logs complexos de máquinas e dados de sensores, gerando uma análise imprecisa da causa raiz e prolongando o tempo de inatividade. Para resolver isso, a Articul8 AI desenvolveu uma plataforma de IA generativa de nível corporativo usando modelos especializados do Meta Llama. Trabalhando com a Meta e a Amazon Web Services (AWS), a Articul8 criou modelos específicos de domínio que identificam falhas de equipamentos com uma precisão geral de 88%, oferecendo a maior densidade de inteligência específica do domínio. Isso permite que os líderes industriais transfiram os esforços da coleta manual de dados para a mitigação proativa de riscos e uma resolução mais rápida da manutenção.

Rompimento do ruído branco da IA de uso geral

A Articul8 AI fornece uma plataforma de IA generativa de nível corporativo que permite que setores como energia e manufatura criem aplicativos que vão muito além do chatbot básico. Nesses setores, os modelos de uso geral geralmente falham porque não têm o profundo conhecimento técnico necessário para interpretar conjuntos de dados complexos, como logs de máquinas e dados de sensores do chão de fábrica. Por exemplo, na geração e no armazenamento de energia, um modelo deve ser capaz de distinguir entre nuances técnicas altamente especializadas para ajudar com problemas de projeto ou planejar interrupções críticas de manutenção. Para pessoas que não são especialistas, essas particularidades técnicas podem parecer um ruído branco, mas para engenheiros, a incapacidade de um modelo de entender esses detalhes torna a saída não confiável para análises de causa raiz de alto risco.

O impacto dessa lacuna de especialização representa enormes perdas financeiras e a falta de diferenciação competitiva. Na fabricação, a falha do equipamento se transforma diretamente em um custoso tempo de inatividade da produção; como explica Felipe Viana, chefe de pesquisa aplicada da Articul8: “Quando uma fábrica não está produzindo, ela essencialmente não está ganhando dinheiro. Fazer com que essa instalação volte a funcionar com mais rapidez não é apenas uma meta técnica, como também significa recuperar a receita”. Além desses custos operacionais imediatos, as organizações que dependem exclusivamente de modelos prontos para uso enfrentam um problema de defensibilidade de longo prazo. Se todas as empresas de serviços públicos usam o mesmo modelo geral, a única diferenciação é a engenharia de prompts, uma barreira superficial que não protege nem aproveita os dados proprietários.

Além desses obstáculos estratégicos, as empresas industriais são desafiadas por uma tensão crítica entre a densidade da inteligência, ou seja, o poder de raciocínio de um modelo em relação ao seu tamanho, e as restrições de infraestrutura. Para alcançar um desempenho de nível especializado, as organizações são tradicionalmente forçadas a escalar seu espaço computacional indefinidamente, o que rapidamente se torna inviável em termos de custos. Além disso, muitos clientes exigem que os aplicativos sejam completamente isolados ou implantados em nuvens privadas virtuais (VPCs) estritamente controladas para garantir a segurança. Isso cria uma desvantagem de alto risco: as empresas precisam de uma solução com densidade de inteligência suficiente para lidar com fluxos de trabalho agênticos complexos e de nível especializado e eficiente o suficiente para caber em uma área de hardware compatível com os orçamentos existentes.

Criação de IA industrial especializada com o Meta Llama 4 no Amazon SageMaker HyperPod

Para preencher a lacuna entre a infraestrutura bruta e os aplicativos corporativos, a Articul8 desenvolveu uma plataforma que transforma modelos de base ampla em ativos especializados e de alto desempenho. No centro dessa estratégia está o ModelMesh proprietário, um sofisticado mecanismo de raciocínio agêntico que serve como mecanismo de raciocínio central funcional para a IA industrial. A Articul8 usou a AWS para potencializar essa plataforma, usando o Amazon SageMaker HyperPod para gerenciar workloads de treinamento complexas e distribuídas com a flexibilidade granular necessária para modelos industriais de grande escala. Utilizando as versões Slurm e Amazon Elastic Kubernetes Service (Amazon EKS) do HyperPod, a equipe de pesquisa aplicada da Articul8 realiza um pré-treinamento contínuo nos modelos básicos do Meta Llama-4-Maverick. Esse processo injeta conhecimento específico do domínio, proveniente de uma combinação selecionada de corporações técnicas e científicas, diretamente na arquitetura do modelo. A Articul8 então refina esses modelos por meio de um ciclo iterativo de ajuste fino supervisionado e aprendizado por reforço para garantir o raciocínio em nível de especialista. Para executar esse treinamento intensivo em setores como energia e manufatura, a Articul8 conta com instâncias do Amazon Elastic Compute Cloud (Amazon EC2), que mantêm alto desempenho e integridade de dados em todo o pipeline.

A Articul8 selecionou o Meta Llama como o núcleo desse mecanismo porque ele fornece a primeira estrutura estável e de código aberto capaz de mesclar entradas multimodais, como desenhos CAD e logs de sensores, com workloads sofisticadas de texto agêntico. Essa densidade de inteligência permite que a Articul8 forneça insights de nível especializado, mantendo poucos parâmetros. Esse é um requisito vital para clientes industriais que operam dentro de orçamentos rígidos de hardware que não podem se dar ao luxo de executar modelos massivos de uso geral. Felipe observa: “Antes do Llama, tínhamos que orquestrar modelos separados e fragmentados para texto e visão. O Llama foi a primeira base sólida que nos capacitou a construir um sistema único e unificado que domina simultaneamente aplicações multimodais e fluxos de trabalho agênticos complexos”.

A implantação na AWS permite que a Articul8 forneça uma arquitetura que prioriza a segurança e atenda às rigorosas demandas dos setores regulamentados. Como muitos clientes de serviços públicos e de manufatura devem manter um controle estrito sobre seus ambientes, a Articul8 usa o Amazon Virtual Private Cloud (Amazon VPC) para hospedar sua plataforma dentro da própria infraestrutura segura do cliente. Optar por esse modelo de implantação ajuda a verificar se os dados proprietários de uma empresa permanecem protegidos pelos próprios protocolos de segurança e, ao mesmo tempo, se beneficiam da escala da nuvem. Uma estreita colaboração técnica com a AWS refinou ainda mais essa arquitetura, fornecendo à Articul8 suporte aprofundado e acesso antecipado a otimizações de infraestrutura que aceleraram a transição do protótipo para a produção. Em última análise, a sinergia entre a infraestrutura da AWS e os modelos abertos da Meta oferece uma alternativa confiável e econômica aos modelos genéricos de fronteira, oferecendo aos líderes industriais um caminho especializado para a IA de nível de produção.

Definição da precisão SOTA e a confiabilidade de nível industrial

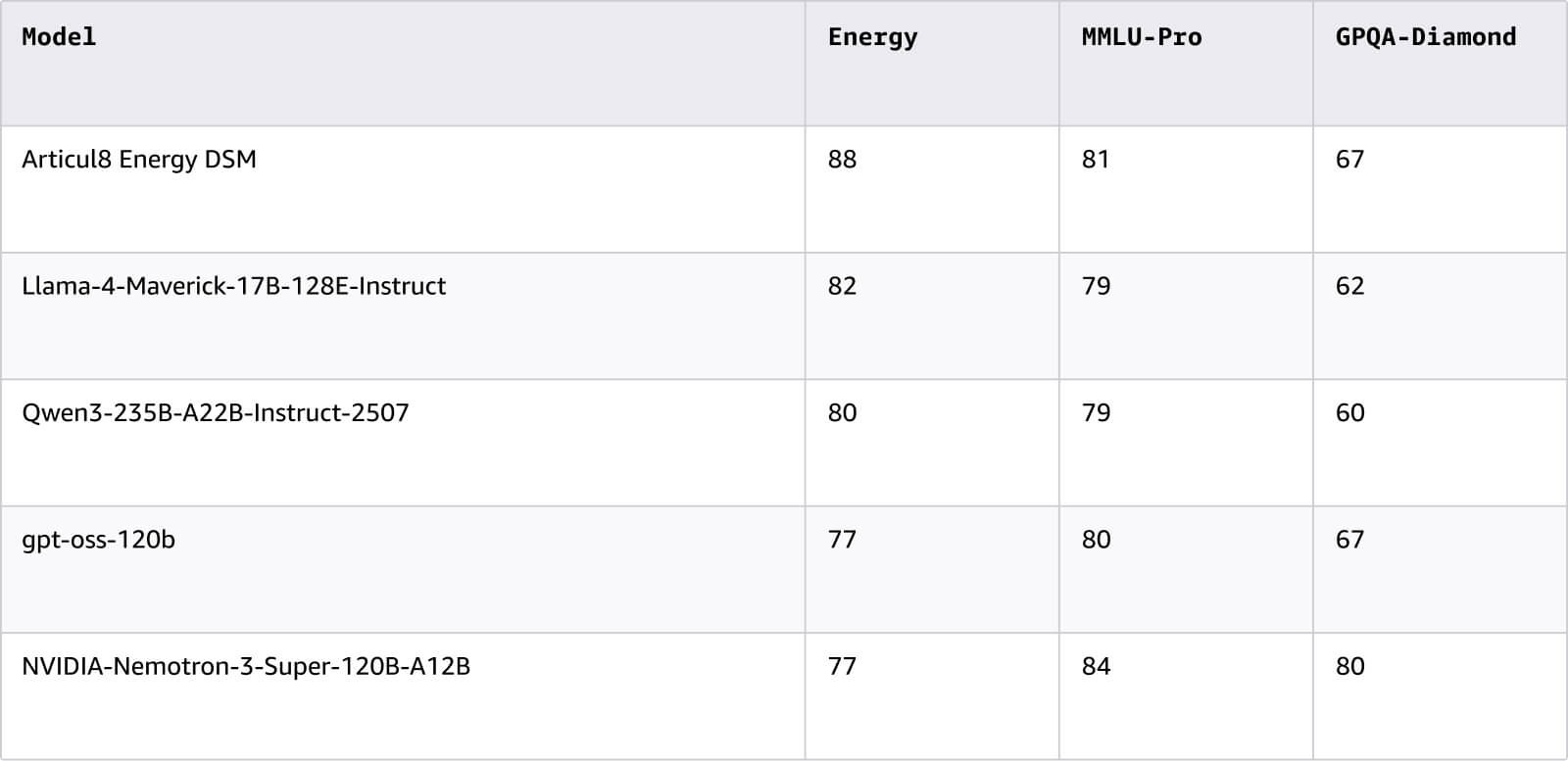

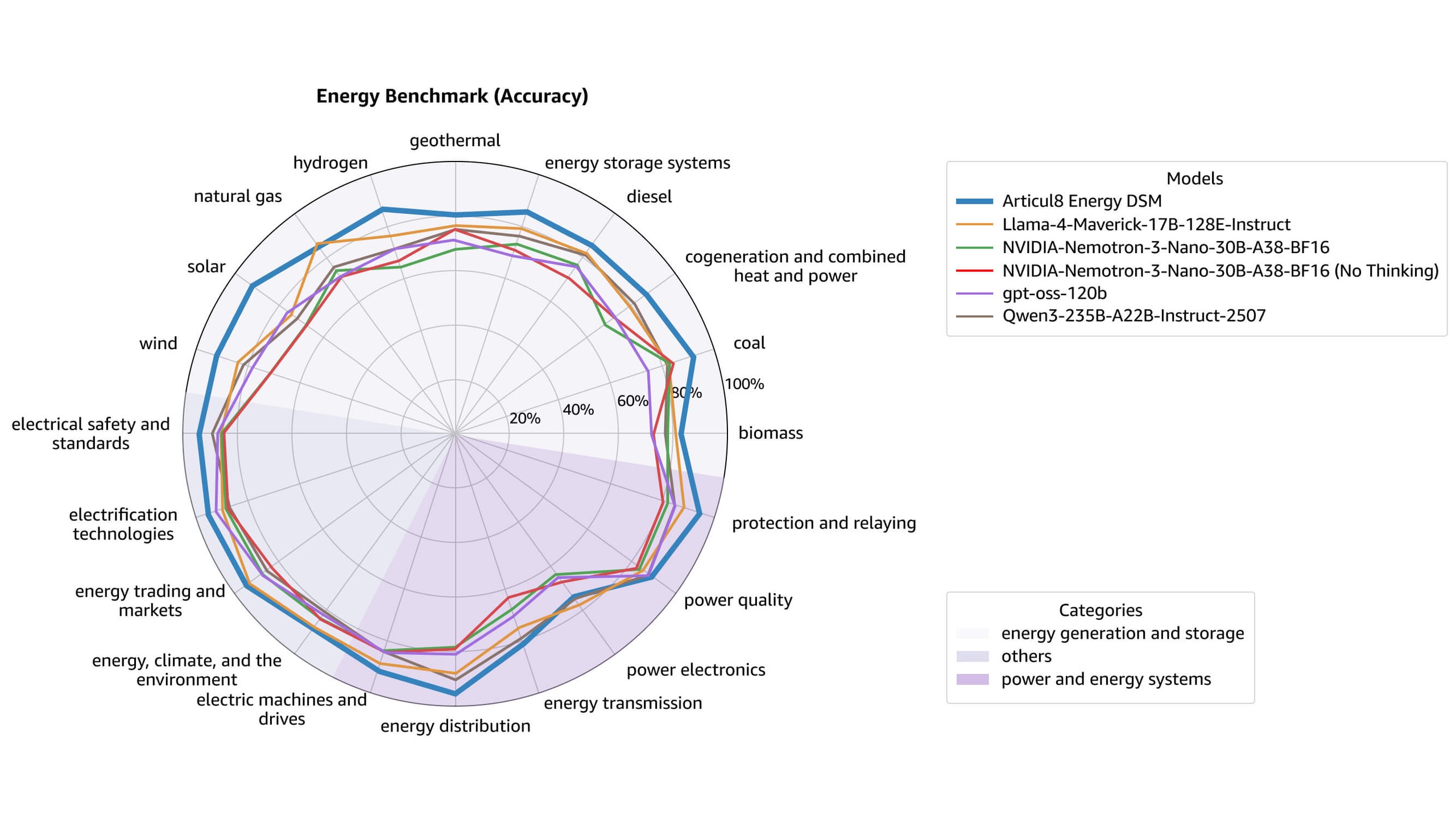

Ao arquitetar a plataforma na AWS com o Meta Llama, a Articul8 basicamente redefiniu o teto de desempenho da IA generativa industrial. A transição para uma arquitetura de modelo específico de domínio (DSM) proporcionou um grande salto na precisão técnica, especialmente para o setor de energia. De acordo com os benchmarks de energia da empresa, o Articul8 Energy DSM alcançou uma precisão geral de 88%, conforme mostrado na tabela abaixo. A figura a seguir ilustra o benchmark por tópico.

Ao basear a plataforma em dados técnicos proprietários, em vez de uma simples engenharia de prompts, a Articul8 permite que seus clientes criem uma vantagem competitiva justificável e de longo prazo. O impacto operacional é mais evidente em ambientes complexos de manufatura e serviços públicos, onde fluxos de trabalho agênticos especializados agora identificam e resolvem falhas de equipamentos com uma velocidade sem precedentes. Ao transformar as particularidades técnicas do ruído branco em inteligência acionável, a plataforma permite que as instalações retornem à produção rapidamente, recuperando efetivamente a receita que antes era perdida devido ao tempo de inatividade.

A sinergia entre a infraestrutura da AWS e a densidade de inteligência do Llama também proporcionou estabilidade crítica ao sistema. A Articul8 aumentou com sucesso a experiência de domínio, mantendo um número compacto de parâmetros e permitindo que os clientes implantassem IA de nível especializado em seu próprio Amazon VPC sem exceder os orçamentos rígidos de hardware. Felipe observa: “O fato de o sistema ser menos complexo significa que ele é mais estável e mais confiável. Você não vê essas histórias quando analisa os benchmarks, mas nossos clientes sim”. Evoluir a partir dessa base confiável é mais do que resolver ineficiências operacionais imediatas; ela fornece a estrutura escalável necessária para que as empresas avancem em direção a fluxos de trabalho agênticos totalmente autônomos e de nível especializado em toda a rede de energia global. Tudo pronto para treinar e implantar modelos em grande escala? Saiba como o Amazon SageMaker e o Amazon EC2 podem ajudar você a criar, iterar e executar workloads de IA até mesmo nos ambientes em tempo real mais exigentes.

Como estava esse conteúdo?