Come ti è sembrato il contenuto?

- Scopri

- Articul8 AI colma il divario di competenze industriali con modelli Llama 4 specializzati e un'architettura AWS incentrata sulla sicurezza

Articul8 AI colma il divario di competenze industriali con modelli Llama 4 specializzati e un'architettura AWS incentrata sulla sicurezza

Le imprese industriali si trovano ad affrontare rischi finanziari significativi e ritardi operativi quando utilizzano modelli di intelligenza artificiale generici che trattano i dati tecnici specializzati come rumore bianco. Questi approcci faticano a interpretare i complessi log delle macchine e i dati dei sensori, portando ad analisi imprecise delle cause principali e a tempi di inattività prolungati. Per risolvere questo problema, Articul8 AI ha sviluppato una piattaforma di IA generativa di livello aziendale utilizzando modelli Meta Llama specializzati. Lavorando con Meta e Amazon Web Services (AWS), Articul8 ha creato modelli specifici per settore che identificano i guasti delle apparecchiature con una precisione complessiva dell'88%, offrendo la più alta densità di informazioni specifiche per settore. Ciò consente ai leader industriali di spostare l'attenzione dalla raccolta manuale dei dati alla mitigazione proattiva dei rischi e a una risoluzione più rapida dei problemi di manutenzione.

Superare il rumore di fondo dell'IA generica

Articul8 AI offre una piattaforma di IA generativa di livello enterprise che consente a settori come quello energetico e manifatturiero di creare applicazioni che vanno ben oltre un semplice chatbot. In questi settori, i modelli generici spesso si rivelano inadeguati perché privi delle competenze tecniche approfondite necessarie per interpretare set di dati complessi, come i log delle macchine e i dati dei sensori provenienti da un impianto di produzione. Ad esempio, nella generazione e nello stoccaggio di energia, un modello deve essere in grado di distinguere tra sfumature tecniche altamente specializzate per facilitare la risoluzione di problemi di progettazione o la pianificazione di fermi per manutenzione critici. Per un non esperto, queste particolarità tecniche potrebbero sembrare insignificanti, ma per un ingegnere, l'incapacità di un modello di cogliere questi dettagli rende l'output inaffidabile per analisi di cause profonde ad alto rischio.

L'impatto di questa carenza di competenze si misura in ingenti perdite finanziarie e nella mancanza di differenziazione competitiva. Nel settore manifatturiero, un guasto alle apparecchiature si traduce direttamente in costosi fermi di produzione; come spiega Felipe Viana, responsabile della ricerca applicata presso Articul8: "Quando un impianto non produce, essenzialmente non genera profitto. Riportare in funzione quell'impianto più velocemente non è solo un obiettivo tecnico, ma si traduce direttamente in un recupero di fatturato". Oltre a questi costi operativi immediati, le organizzazioni che si affidano esclusivamente a modelli standard si trovano ad affrontare un problema di difendibilità a lungo termine. Se ogni azienda di servizi utilizza lo stesso modello generale, la loro unica differenziazione è la progettazione dei prompt, una barriera superficiale che non protegge né valorizza i loro dati proprietari.

Al di là di questi ostacoli strategici, le imprese industriali si trovano ad affrontare una tensione critica tra densità di intelligenza, ovvero la capacità di ragionamento di un modello in relazione alle sue dimensioni, e vincoli infrastrutturali. Per raggiungere prestazioni di livello esperto, le organizzazioni sono state tradizionalmente costrette ad aumentare indefinitamente la propria infrastruttura di calcolo, il che diventa rapidamente proibitivo in termini di costi. Inoltre, molti clienti richiedono che le applicazioni siano completamente isolate dalla rete o distribuite all'interno di cloud privati virtuali (VPC) rigorosamente controllati per garantire la sicurezza. Questo crea un compromesso cruciale: le imprese necessitano di una soluzione con una densità di intelligenza sufficiente a gestire flussi di lavoro complessi e di livello esperto, ma al contempo sufficientemente efficiente da rientrare in un'infrastruttura hardware compatibile con i budget esistenti.

Creazione di un'IA industriale specializzata con Meta Llama 4 su Amazon SageMaker HyperPod

Per colmare il divario tra infrastruttura grezza e applicazioni aziendali, Articul8 ha sviluppato una piattaforma che trasforma modelli di ampio respiro in risorse specializzate e ad alte prestazioni. Al centro di questa strategia c’è il ModelMesh proprietario dell’azienda, un sofisticato motore di ragionamento agentico che funge da motore di ragionamento centrale funzionale per l’IA industriale. Articul8 ha utilizzato AWS per alimentare questa piattaforma, utilizzando Amazon SageMaker HyperPod per gestire carichi di lavoro di addestramento complessi e distribuiti con la flessibilità granulare richiesta per modelli industriali su larga scala. Utilizzando le versioni sia Slurm che Amazon Elastic Kubernetes Service (Amazon EKS) di HyperPod, il team di ricerca applicata di Articul8 esegue un addestramento preliminare continuo sui modelli fondazione Meta Llama-4-Maverick. Questo processo inietta conoscenze specifiche del dominio provenienti da un mix curato di corpus tecnici e scientifici direttamente nell’architettura del modello. Articul8 perfeziona quindi questi modelli attraverso un ciclo iterativo di fine-tuning supervisionato e apprendimento per rinforzo per garantire un ragionamento di livello esperto. Per eseguire questo addestramento intensivo per settori come l’energia e la produzione, Articul8 si affida alle istanze Amazon Elastic Compute Cloud (Amazon EC2), che mantengono alte prestazioni e integrità dei dati in tutta la pipeline.

Articul8 ha scelto Meta Llama come nucleo di questo motore perché fornisce il primo framework stabile e open source in grado di unire input multimodali, come disegni CAD e log di sensori, con sofisticati carichi di lavoro di testo agentico. Questa densità di intelligenza consente ad Articul8 di fornire insight di livello esperto mantenendo basso il numero di parametri. Questo è un requisito fondamentale per i clienti industriali che operano con budget hardware limitati e non possono permettersi di eseguire modelli generici di grandi dimensioni. Viana osserva: "Prima di Llama, dovevamo orchestrare modelli separati e frammentati per testo e immagini. Llama è stata la prima solida base che ci ha permesso di costruire un unico sistema unificato in grado di gestire simultaneamente applicazioni multimodali e flussi di lavoro complessi basati su agenti."

La distribuzione su AWS consente ad Articul8 di fornire un'architettura incentrata sulla sicurezza che soddisfa i severi requisiti dei settori regolamentati. Poiché molti clienti del settore delle utility e del settore manifatturiero devono mantenere un controllo rigoroso sui propri ambienti, Articul8 utilizza Amazon Virtual Private Cloud (Amazon VPC) per ospitare la propria piattaforma all'interno dell'infrastruttura sicura del cliente. La scelta di questo modello di distribuzione aiuta a verificare che i dati proprietari di un'azienda rimangano protetti secondo i propri protocolli di sicurezza, pur beneficiando della scalabilità del cloud. Una stretta collaborazione tecnica con AWS ha ulteriormente perfezionato questa architettura, fornendo ad Articul8 un supporto approfondito e un accesso anticipato alle ottimizzazioni dell'infrastruttura che hanno accelerato la transizione dal prototipo alla produzione. In definitiva, la sinergia tra l'infrastruttura AWS e i modelli open weight di Meta offre un'alternativa affidabile ed economica ai modelli di frontiera generici, offrendo ai leader industriali un percorso specializzato verso l'intelligenza artificiale di livello di produzione.

Raggiungere l'accuratezza SOTA e un'affidabilità di livello industriale

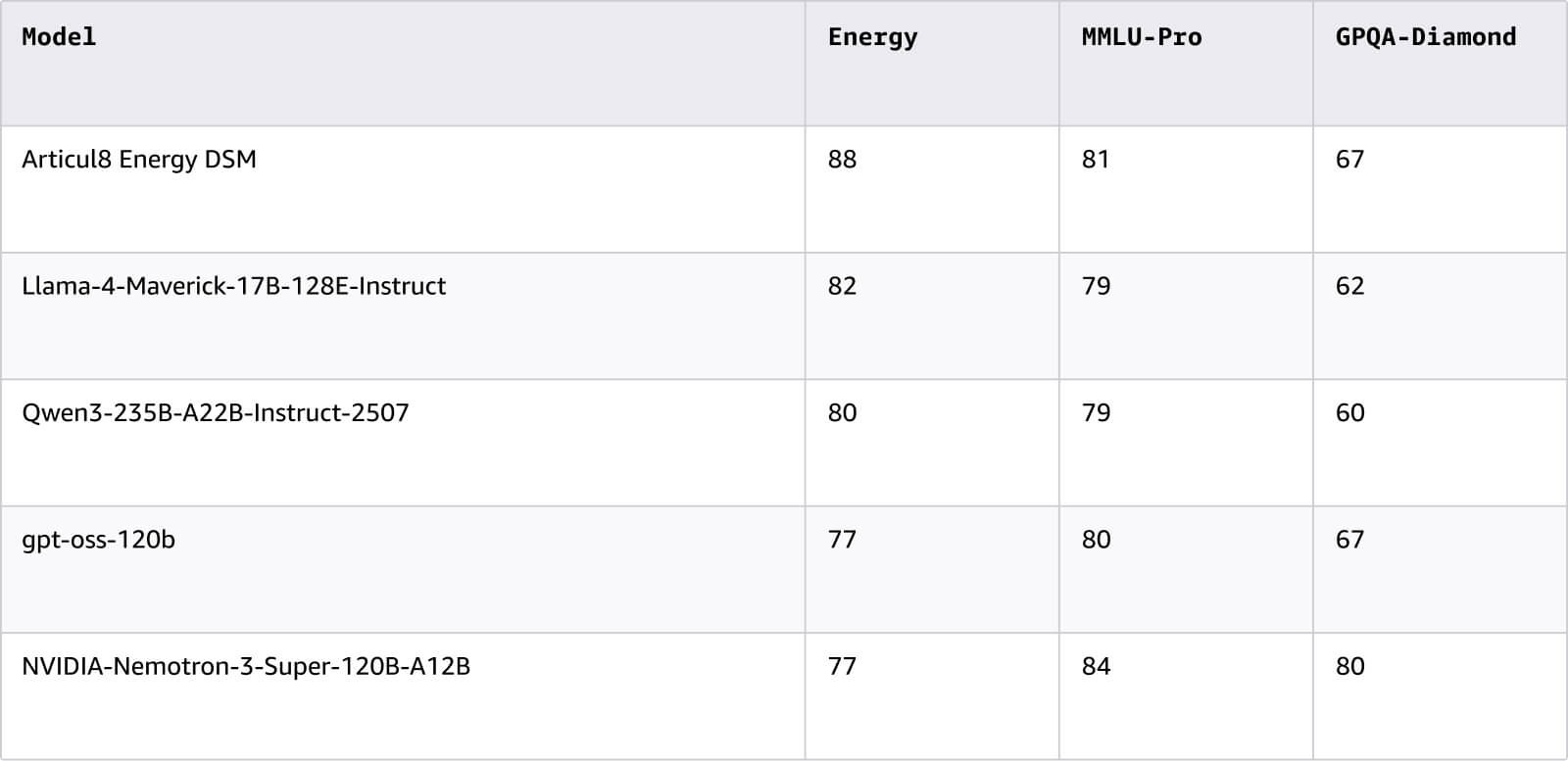

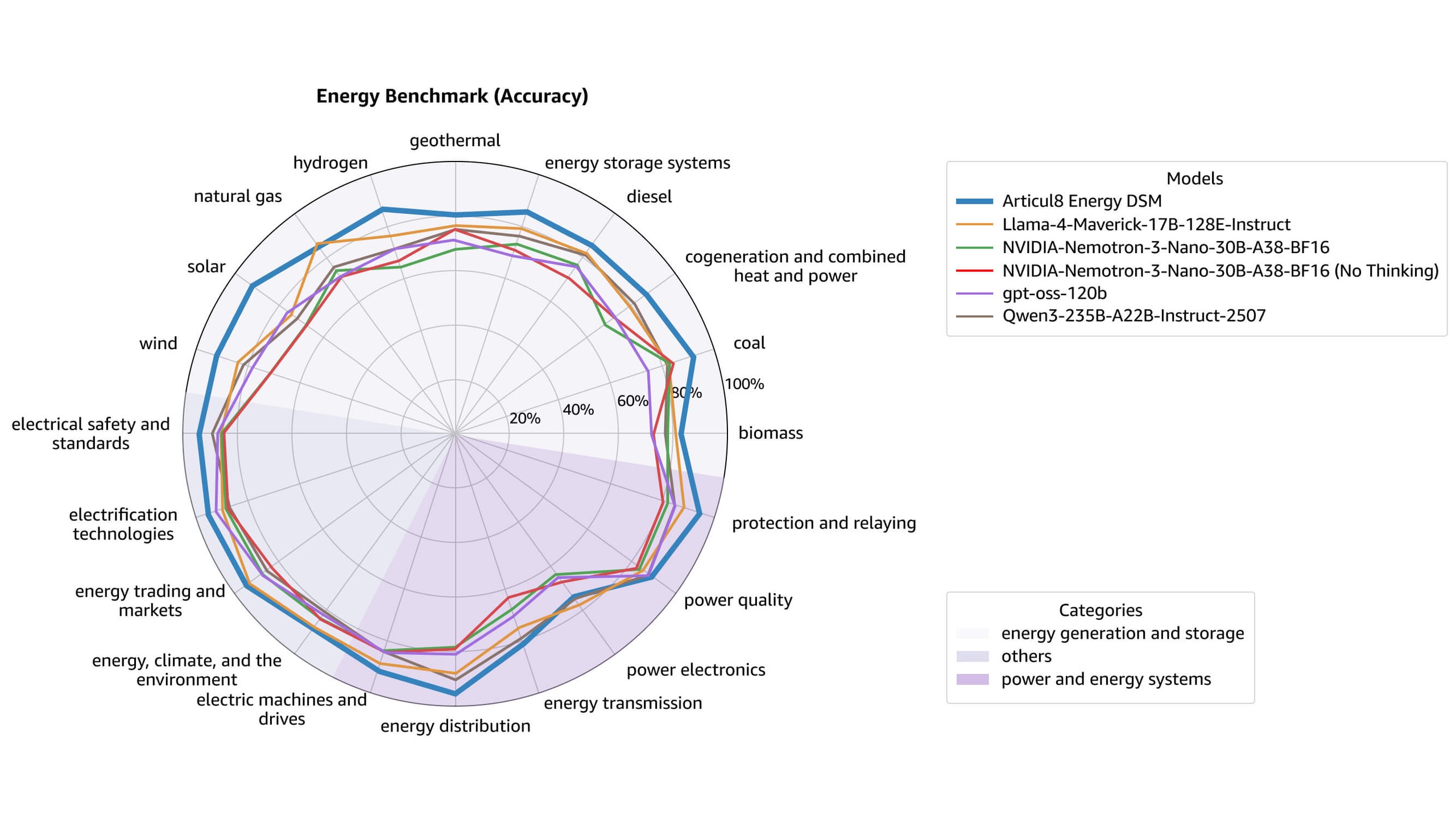

Grazie all'architettura della sua piattaforma su AWS con Meta Llama, Articul8 ha ridefinito radicalmente i limiti prestazionali dell'IA generativa industriale. La transizione a un'architettura basata su modelli specifici per dominio (DSM) ha portato a un enorme salto di precisione tecnica, in particolare per il settore energetico. Secondo i benchmark energetici dell'azienda, il DSM di Articul8 per il settore energetico ha raggiunto un'accuratezza complessiva dell'88%, come mostrato nella tabella seguente. La figura successiva illustra il benchmark per argomento.

Basando la piattaforma su dati tecnici proprietari anziché su semplice progettazione dei prompt, Articul8 consente ai suoi clienti di costruire un vantaggio competitivo solido e duraturo. L'impatto operativo è particolarmente evidente in ambienti complessi di produzione e servizi di pubblica utilità, dove flussi di lavoro automatizzati specializzati identificano e risolvono i guasti delle apparecchiature con una velocità senza precedenti. Trasformando le peculiarità tecniche da semplici informazioni strumentali in dati utili, la piattaforma permette agli impianti di riprendere rapidamente la produzione, recuperando efficacemente i ricavi precedentemente persi a causa dei tempi di inattività.

La sinergia tra l'infrastruttura AWS e la densità di intelligenza di Llama ha inoltre garantito una stabilità di sistema fondamentale. Articul8 è riuscito ad aumentare le competenze specifiche del settore mantenendo un numero ridotto di parametri, consentendo ai clienti di implementare l'IA a livello esperto nella propria Amazon VPC senza superare i rigidi budget hardware. Viana osserva: "Il fatto che il sistema sia meno complesso significa che è più stabile e affidabile. Questi aspetti non emergono dai benchmark, ma i nostri clienti sì". Costruire su queste solide basi non solo risolve le inefficienze operative immediate, ma fornisce anche il framework scalabile necessario alle aziende per passare a flussi di lavoro agentici completamente autonomi e di livello esperto nell'intera rete energetica globale. Sei pronto per addestrare e implementare modelli su larga scala? Scopri come Amazon SageMaker e Amazon EC2 possono aiutarti a creare, iterare ed eseguire carichi di lavoro IA anche per gli ambienti in tempo reale più impegnativi.

Come ti è sembrato il contenuto?