¿Qué le pareció este contenido?

- Aprender

- Articul8 AI cierra la brecha de experiencia industrial con modelos Llama 4 especializados y una arquitectura de AWS que prioriza la seguridad

Articul8 AI cierra la brecha de experiencia industrial con modelos Llama 4 especializados y una arquitectura de AWS que prioriza la seguridad

Las empresas industriales se enfrentan a importantes riesgos financieros y retrasos operativos cuando utilizan modelos de IA de uso general que tratan los datos técnicos especializados como ruido blanco. Estos enfoques tienen dificultades para interpretar los complejos registros de las máquinas y los datos de los sensores, lo que conduce a un análisis impreciso de las causas raíz y a un tiempo de inactividad prolongado. Para abordar este problema, Articul8 AI desarrolló una plataforma de IA generativa de nivel empresarial utilizando modelos especializados de Meta Llama. Al trabajar con Meta y Amazon Web Services (AWS), Articul8 creó modelos específicos para cada dominio que identifican los fallos de los equipos con una precisión general del 88%, lo que brinda la mayor densidad de inteligencia específica para cada dominio. Esto permite a los líderes industriales pasar de la recopilación manual de datos a la mitigación proactiva de los riesgos y a la resolución más rápida del mantenimiento.

Superación del ruido blanco de la IA de uso general

Articul8 AI proporciona una plataforma de IA generativa de nivel empresarial que permite a sectores como el energético y el manufacturero crear aplicaciones que van mucho más allá del chatbot básico. En estos sectores, los modelos de uso general suelen ser insuficientes porque carecen de los profundos conocimientos técnicos necesarios para interpretar conjuntos de datos complejos, como los registros de las máquinas y los datos de los sensores de una planta de fabricación. Por ejemplo, en la generación y el almacenamiento de energía, un modelo debe poder distinguir entre matices técnicos altamente especializados para ayudar a resolver problemas de diseño o planificar interrupciones críticas de mantenimiento. Para una persona no experta, estas particularidades técnicas pueden parecer ruido blanco, pero para un ingeniero, la incapacidad de un modelo para comprender estos detalles hace que el resultado no sea fiable para analizar las causas fundamentales de alto riesgo.

El impacto de esta brecha de experiencia se mide en pérdidas financieras masivas y en la falta de diferenciación competitiva. En la fabricación, los fallos de los equipos se traducen directamente en costosos tiempos de inactividad de la producción; como explica Felipe Viana, jefe de investigación aplicada de Articul8: “Cuando una planta no produce, básicamente no genera dinero. Hacer que esas instalaciones vuelvan a estar en funcionamiento más rápido no es solo un objetivo técnico, sino que se traduce directamente en la recuperación de ingresos”. Más allá de estos costos operativos inmediatos, las organizaciones que dependen únicamente de modelos listos para usar se enfrentan a un problema de capacidad de defensa a largo plazo. Si todas las empresas de servicios públicos utilizan el mismo modelo general, su única diferencia es la ingeniería rápida, una barrera poco profunda que no protege ni aprovecha sus datos patentados.

Más allá de estos obstáculos estratégicos, las empresas industriales se enfrentan al desafío de una tensión crítica entre la densidad de inteligencia (el poder de razonamiento de un modelo en relación con su tamaño) y las restricciones de infraestructura. Para lograr un rendimiento de nivel experto, las organizaciones tradicionalmente se han visto obligadas a ampliar su espacio de procesamiento de forma indefinida, lo que rápidamente se convierte en algo prohibitivo. Además, muchos clientes requieren que las aplicaciones estén completamente aisladas o que se implementen en nubes privadas virtuales (VPC) estrictamente controladas para garantizar la seguridad. Esto genera un alto riesgo: las empresas necesitan una solución con la suficiente densidad de inteligencia para gestionar flujos de trabajo complejos de agentes a nivel de expertos, pero lo suficientemente eficiente como para caber dentro de un espacio de hardware compatible con sus presupuestos actuales.

Creación de IA industrial especializada con Meta Llama 4 en Amazon SageMaker HyperPod

Para cerrar la brecha entre la infraestructura sin procesar y las aplicaciones empresariales, Articul8 desarrolló una plataforma que transforma los modelos de base amplia en activos especializados de alto rendimiento. Un elemento fundamental de esta estrategia es su propio ModelMesh, un sofisticado motor de razonamiento agencial que sirve como motor de razonamiento central funcional para la IA industrial. Articul8 usó AWS para impulsar esta plataforma y usó Amazon SageMaker HyperPod para administrar cargas de trabajo de entrenamiento complejas y distribuidas con la flexibilidad granular requerida para los modelos industriales a gran escala. Al utilizar las versiones de Slurm y Amazon Elastic Kubernetes Service (Amazon EKS) de HyperPod, el equipo de investigación aplicada de Articul8 realiza un entrenamiento previo continuo sobre los modelos básicos de Meta Llama-4-Maverick. Este proceso inyecta directamente en la arquitectura del modelo conocimientos específicos de cada dominio, procedentes de una combinación selecta de corpus técnicos y científicos. Luego, Articul8 refina estos modelos a través de un ciclo iterativo de refinamiento y aprendizaje por refuerzo supervisados para garantizar un razonamiento a nivel de experto. Para llevar a cabo este entrenamiento intensivo en sectores como la energía y la fabricación, Articul8 confía en las instancias de Amazon Elastic Compute Cloud (Amazon EC2), que mantienen un alto rendimiento y la integridad de los datos durante todo el proceso.

Articul8 seleccionó a Meta Llama como el núcleo de este motor porque proporciona el primer marco estable de código abierto capaz de combinar entradas multimodales, como dibujos CAD y registros de sensores, con sofisticadas cargas de trabajo de texto agenciales. Esta densidad de inteligencia permite a Articul8 ofrecer información de nivel experto y, al mismo tiempo, mantener bajos los recuentos de parámetros. Este es un requisito vital para los clientes industriales que operan con presupuestos de hardware estrictos y no pueden permitirse el lujo de ejecutar modelos masivos de uso general. Viana señala: “Antes de Llama, teníamos que orquestar modelos separados y fragmentados para el texto y la visión. Llama fue la primera base sólida que nos permitió crear un sistema único y unificado que domine simultáneamente tanto las aplicaciones multimodales como los complejos flujos de trabajo agenciales”.

La implementación en AWS permite a Articul8 proporcionar una arquitectura que prioriza la seguridad y que cumple con las estrictas exigencias de los sectores regulados. Dado que muchos clientes de empresas de servicios públicos y fabricantes deben mantener un control estricto sobre sus entornos, Articul8 utiliza Amazon Virtual Private Cloud (Amazon VPC) para alojar su plataforma dentro de la infraestructura segura del cliente. Optar por este modelo de implementación ayuda a verificar que los datos patentados de una empresa permanecen protegidos según sus propios protocolos de seguridad y, al mismo tiempo, se benefician de la escala de la nube. Una estrecha colaboración técnica con AWS perfeccionó aún más esta arquitectura y proporcionó a Articul8 un soporte profundo y un acceso anticipado a las optimizaciones de la infraestructura, lo que aceleró la transición del prototipo a producción. En última instancia, la sinergia entre la infraestructura de AWS y los modelos abiertos de Meta ofrece una alternativa fiable y rentable a los modelos de frontera genéricos, ya que brinda a los líderes industriales una vía especializada hacia la IA de nivel de producción.

Establecimiento de precisión de SOTA y fiabilidad de nivel industrial

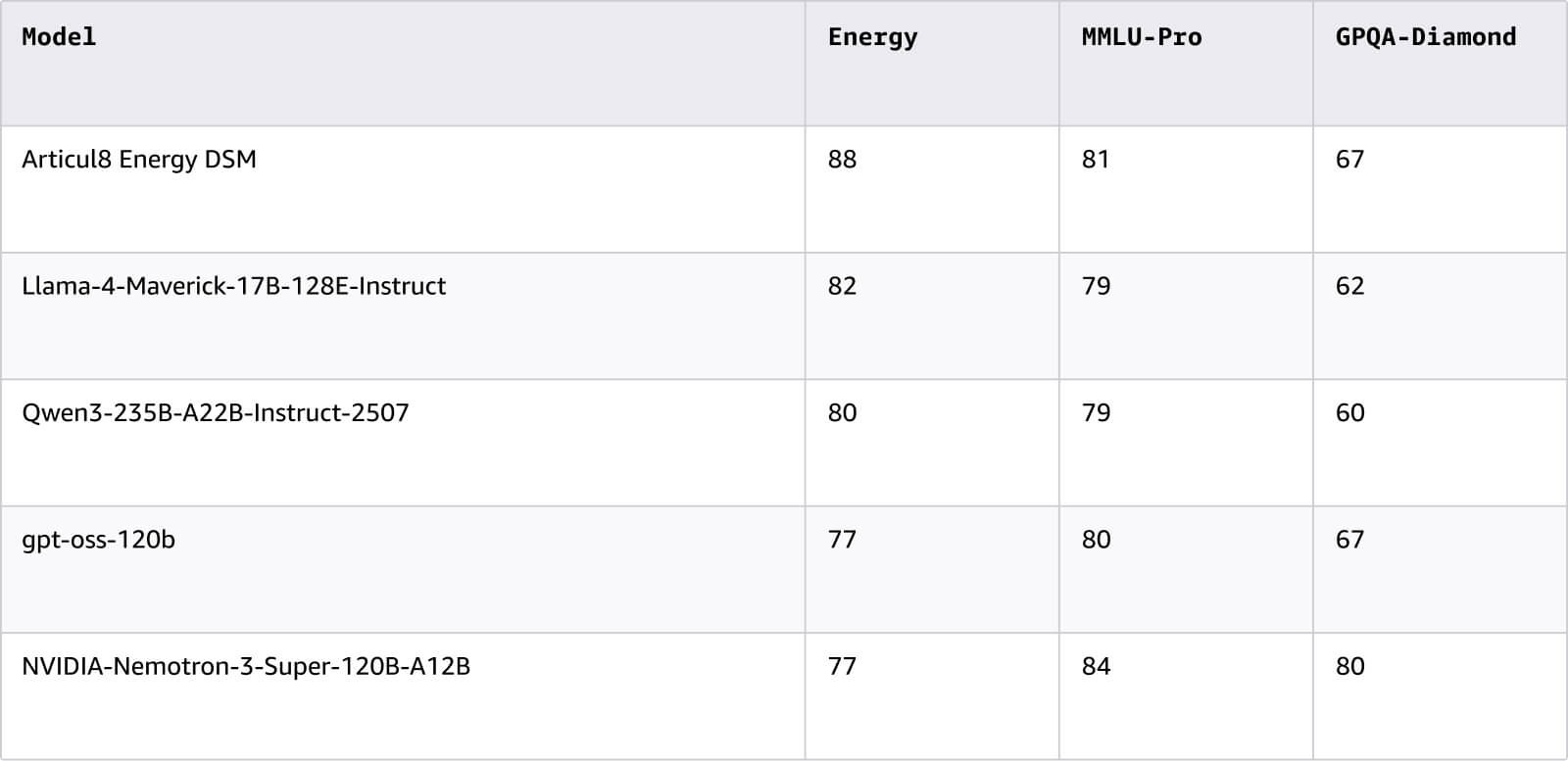

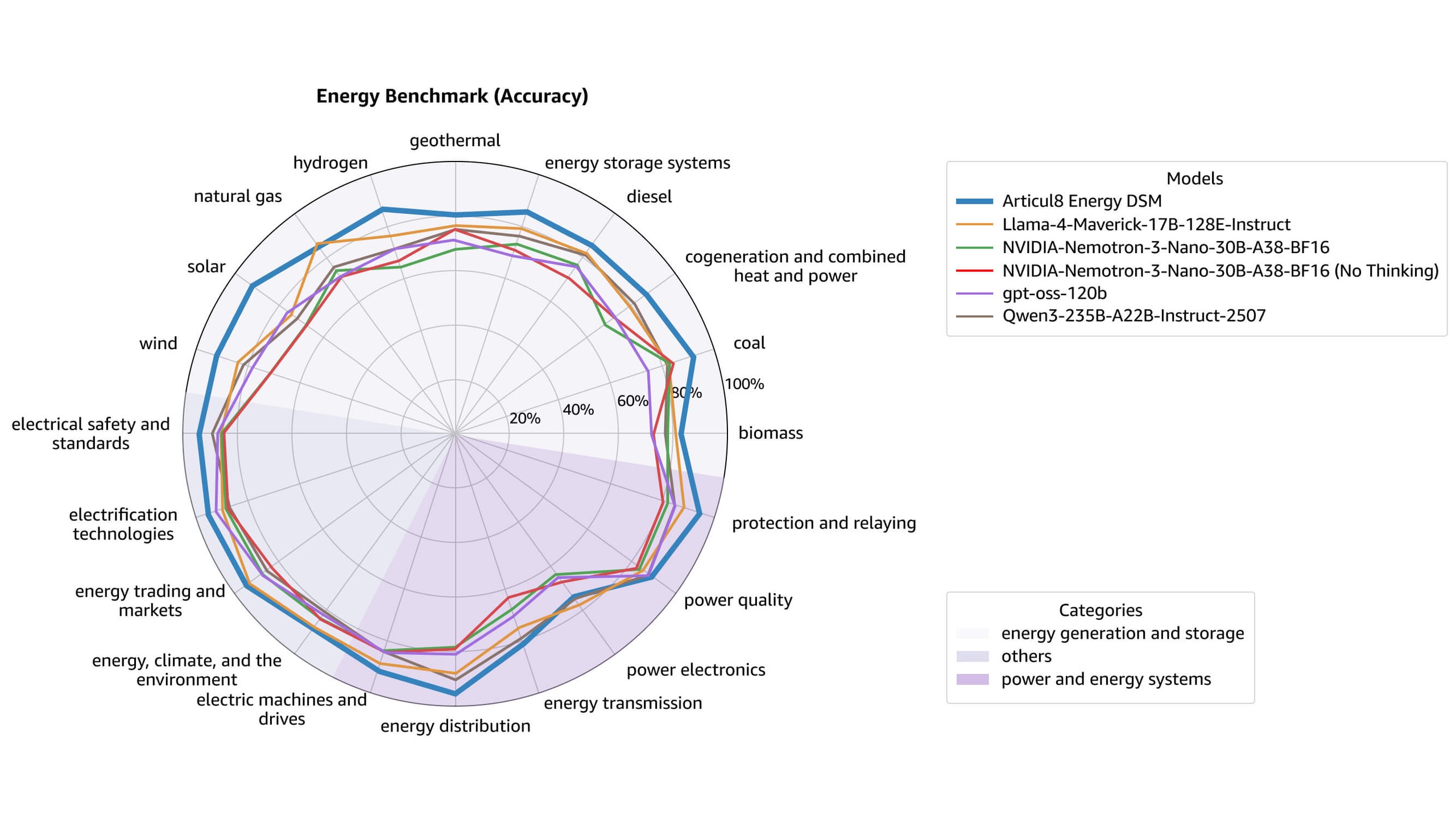

Al diseñar su plataforma en AWS con Meta Llama, Articul8 redefinió radicalmente el límite de rendimiento de la IA generativa industrial. La transición a una arquitectura de modelo de dominio específico (DSM) supuso un enorme salto en la precisión técnica, especialmente para el sector energético. Según las referencias energéticas de la empresa, el DSM de energía de Articul8 logró una precisión global del 88%, como se muestra en la siguiente tabla. La siguiente figura ilustra las referencias por tema.

Al basar la plataforma en datos técnicos patentados en lugar de en una simple ingeniería rápida, Articul8 permite a sus clientes crear una ventaja competitiva defendible y a largo plazo. El impacto operativo es más evidente en los entornos complejos de fabricación y servicios públicos, donde los flujos de trabajo especializados agenciales ahora identifican y resuelven los fallos de los equipos a una velocidad sin precedentes. Al transformar las particularidades técnicas del ruido blanco en inteligencia procesable, la plataforma permite que las instalaciones vuelvan a la producción rápidamente y recuperen de manera efectiva los ingresos que antes se perdían debido al tiempo de inactividad.

La sinergia entre la infraestructura de AWS y la densidad de inteligencia de Llama también proporcionó una estabilidad crítica del sistema. Articul8 aumentó con éxito su experiencia en este campo y, al mismo tiempo, mantuvo un recuento de parámetros compacto, lo que permitió a los clientes implementar inteligencia artificial de nivel experto en su propia VPC de Amazon sin sobrepasar los estrictos presupuestos de hardware. Viana señala: “El hecho de que el sistema sea menos complejo significa que es más estable y fiable. Estas historias no las ves cuando miras las referencias, pero nuestros clientes sí”. Partir de esta base fiable hace más que resolver las ineficiencias operativas inmediatas; proporciona el marco escalable necesario para que las empresas avancen hacia flujos de trabajo agenciales totalmente autónomos y de nivel experto en toda la red energética mundial. ¿Está preparado para entrenar e implementar modelos a escala? Descubra cómo Amazon SageMaker y Amazon EC2 pueden ayudarle a crear, iterar y ejecutar cargas de trabajo de IA incluso para los entornos en tiempo real más exigentes.

¿Qué le pareció este contenido?