Bagaimana konten ini?

- Pelajari

- Artikul8 AI Menjembatani Kesenjangan Keahlian Industri dengan Model Llama 4 khusus dan Arsitektur AWS Pengutamaan Keamanan

Artikul8 AI Menjembatani Kesenjangan Keahlian Industri dengan Model Llama 4 khusus dan Arsitektur AWS Pengutamaan Keamanan

Korporasi industri menghadapi risiko keuangan dan penundaan operasional yang signifikan saat menggunakan model AI tujuan umum yang memperlakukan data teknis khusus sebagai derau putih. Pendekatan ini kesulitan menafsirkan log mesin dan data sensor yang kompleks, yang menyebabkan analisis akar penyebab yang tidak tepat serta waktu henti yang berkepanjangan. Untuk mengatasi hal ini, Articul8 AI mengembangkan platform AI generatif tingkat korporasi menggunakan model Meta Llama khusus. Bekerja dengan Meta dan Amazon Web Services (AWS), Articul8 menciptakan model khusus domain yang mengidentifikasi kegagalan peralatan dengan akurasi keseluruhan 88 persen—memberikan densitas kecerdasan khusus domain tertinggi. Hal ini memberdayakan para pimpinan industri untuk mengalihkan upaya dari pengumpulan data manual ke mitigasi risiko proaktif dan resolusi pemeliharaan yang lebih cepat.

Menerobos derau putih dari AI tujuan umum

Articul8 AI menyediakan platform AI generatif tingkat korporasi yang memungkinkan industri seperti energi dan manufaktur untuk membangun aplikasi yang jauh melampaui chatbot dasar Anda. Di sektor-sektor ini, model tujuan umum sering kali gagal karena mereka tidak memiliki keahlian teknis mendalam yang diperlukan untuk menafsirkan set data yang kompleks, seperti log mesin dan data sensor dari lantai manufaktur. Misalnya, dalam pembangkitan serta penyimpanan energi, model harus dapat membedakan antara nuansa teknis yang sangat khusus untuk membantu masalah desain atau merencanakan pemadaman pemeliharaan kritis. Bagi seorang yang bukan ahli, kekhususan teknis ini mungkin tampak seperti derau putih, tetapi bagi seorang rekayasawan, ketidakmampuan model untuk memahami detail ini membuat hasilnya tidak dapat diandalkan untuk analisis akar penyebab berisiko tinggi.

Dampak dari kesenjangan keahlian ini diukur dalam kerugian finansial yang besar dan kurangnya diferensiasi kompetitif. Dalam manufaktur, kegagalan peralatan secara langsung mengakibatkan waktu henti produksi yang mahal; seperti yang dijelaskan oleh Felipe Viana, head of applied research di Articul8: “Ketika sebuah pabrik tidak berproduksi, pada dasarnya pabrik tersebut tidak menghasilkan uang. Mengembalikan fasilitas tersebut ke jalur produksi lebih cepat bukan hanya tujuan teknis—tetapi secara langsung berdampak pada pemulihan pendapatan.” Di luar biaya operasional langsung ini, organisasi yang hanya mengandalkan model siap pakai menghadapi masalah daya saing jangka panjang. Jika setiap perusahaan utilitas menggunakan model umum yang sama, satu-satunya diferensiasi mereka adalah rekayasa prompt—sebuah penghalang dangkal yang gagal melindungi atau memanfaatkan data kepemilikan mereka.

Di luar rintangan strategis ini, korporasi industri ditantang oleh ketegangan kritis antara densitas kecerdasan—kemampuan penalaran suatu model relatif terhadap ukurannya—dan kendala infrastruktur. Untuk mencapai performa tingkat ahli, organisasi secara tradisional dipaksa untuk menskalakan jejak komputasi mereka tanpa batas waktu, yang dengan cepat menjadi penghalang biaya. Selain itu, banyak pelanggan memerlukan aplikasi untuk sepenuhnya terisolasi atau di-deploy dalam cloud privat virtual (VPC) yang dikontrol ketat demi memastikan keamanan. Hal ini menciptakan pertukaran berisiko tinggi: korporasi membutuhkan solusi dengan densitas kecerdasan yang cukup untuk menangani alur kerja agentik tingkat ahli yang rumit, tetapi cukup efisien untuk masuk ke dalam jejak perangkat keras yang kompatibel dengan anggaran mereka yang ada.

Membangun AI industri khusus dengan Meta Llama 4 di Amazon SageMaker HyperPod

Untuk menjembatani kesenjangan antara infrastruktur mentah dan aplikasi korporasi, Articul8 mengembangkan platform yang mentransformasi model berbasis luas menjadi aset khusus yang beperforma tinggi. Inti dari strategi ini adalah ModelMesh miliknya—sebuah mesin penalaran agentik canggih yang berfungsi sebagai mesin penalaran inti fungsional untuk AI industri. Articul8 menggunakan AWS untuk mendukung platform ini, menggunakan Amazon SageMaker HyperPod untuk mengelola beban kerja pelatihan yang rumit serta terdistribusi dengan fleksibilitas terperinci yang diperlukan untuk model industri skala besar. Memanfaatkan versi Slurm dan Amazon Elastic Kubernetes Service (Amazon EKS) dari HyperPod, tim peneliti terapan Articul8 melakukan prapelatihan lanjutan pada model dasar Meta Llama-4-Maverick. Proses ini menginjeksi pengetahuan khusus domain—bersumber dari campuran perusahaan teknis dan ilmiah terkurasi—langsung ke dalam arsitektur model. Articul8 kemudian menyempurnakan model-model ini melalui putaran iteratif dari penyempurnaan yang diawasi serta pembelajaran penguatan untuk memastikan penalaran tingkat ahli. Untuk melaksanakan pelatihan intensif ini untuk sektor seperti energi dan manufaktur, Articul8 mengandalkan instans Amazon Elastic Compute Cloud (Amazon EC2) , yang mempertahankan performa tinggi dan integritas data di seluruh jalur.

Articul8 memilih Meta Llama sebagai inti dari mesin ini karena menyediakan kerangka kerja sumber terbuka pertama yang stabil yang mampu menggabungkan input multimodal—seperti gambar CAD dan log sensor—dengan beban kerja teks agentik canggih. Densitas kecerdasan ini memungkinkan Articul8 memberikan wawasan tingkat ahli sambil menjaga jumlah parameter tetap rendah. Ini adalah persyaratan penting bagi pelanggan industri yang beroperasi dalam anggaran perangkat keras yang ketat dan tidak mampu menjalankan model tujuan umum yang besar. Viana mencatat, “Sebelum Llama, kami harus mengatur model terpisah serta terfragmentasi untuk teks dan visi. Llama adalah fondasi kokoh pertama yang memberdayakan kami untuk membangun satu sistem yang terpadu yang menguasai aplikasi multimodal dan alur kerja agentik kompleks secara bersamaan.”

Melakukan deployment di AWS memungkinkan Articul8 menyediakan arsitektur pengutamaan keamanan yang memenuhi tuntutan ketat dari industri yang teregulasi. Karena banyak klien utilitas dan manufaktur harus mempertahankan kontrol ketat atas lingkungan mereka, Articul8 menggunakan Amazon Virtual Private Cloud (Amazon VPC) untuk melakukan host platformnya dalam infrastruktur aman milik pelanggan. Memilih model deployment ini membantu memverifikasi bahwa data kepemilikan perusahaan tetap dilindungi di bawah protokol keamanannya sendiri sambil tetap mendapat manfaat dari skala cloud. Kolaborasi teknis yang erat dengan AWS makin menyempurnakan arsitektur ini, memberikan Articul8 dukungan mendalam dan akses awal ke optimisasi infrastruktur yang mempercepat transisi dari prototipe ke produksi. Pada akhirnya, sinergi antara infrastruktur AWS serta model bobot terbuka dari Meta menawarkan alternatif yang andal dan hemat biaya untuk model terdepan generik, memberikan para pimpinan industri jalur khusus menuju AI tingkat produksi.

Menetapkan akurasi SOTA dan keandalan tingkat industri

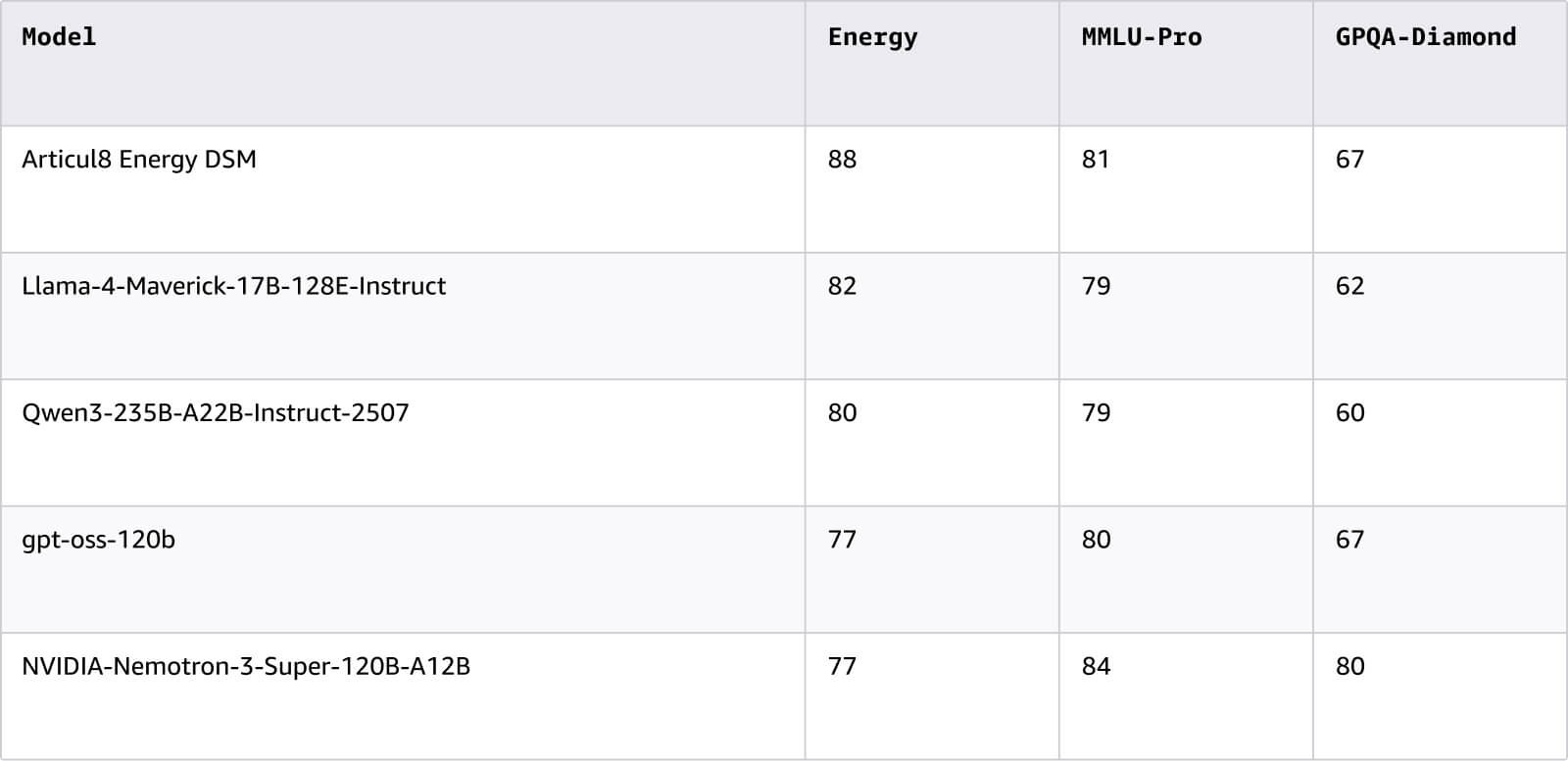

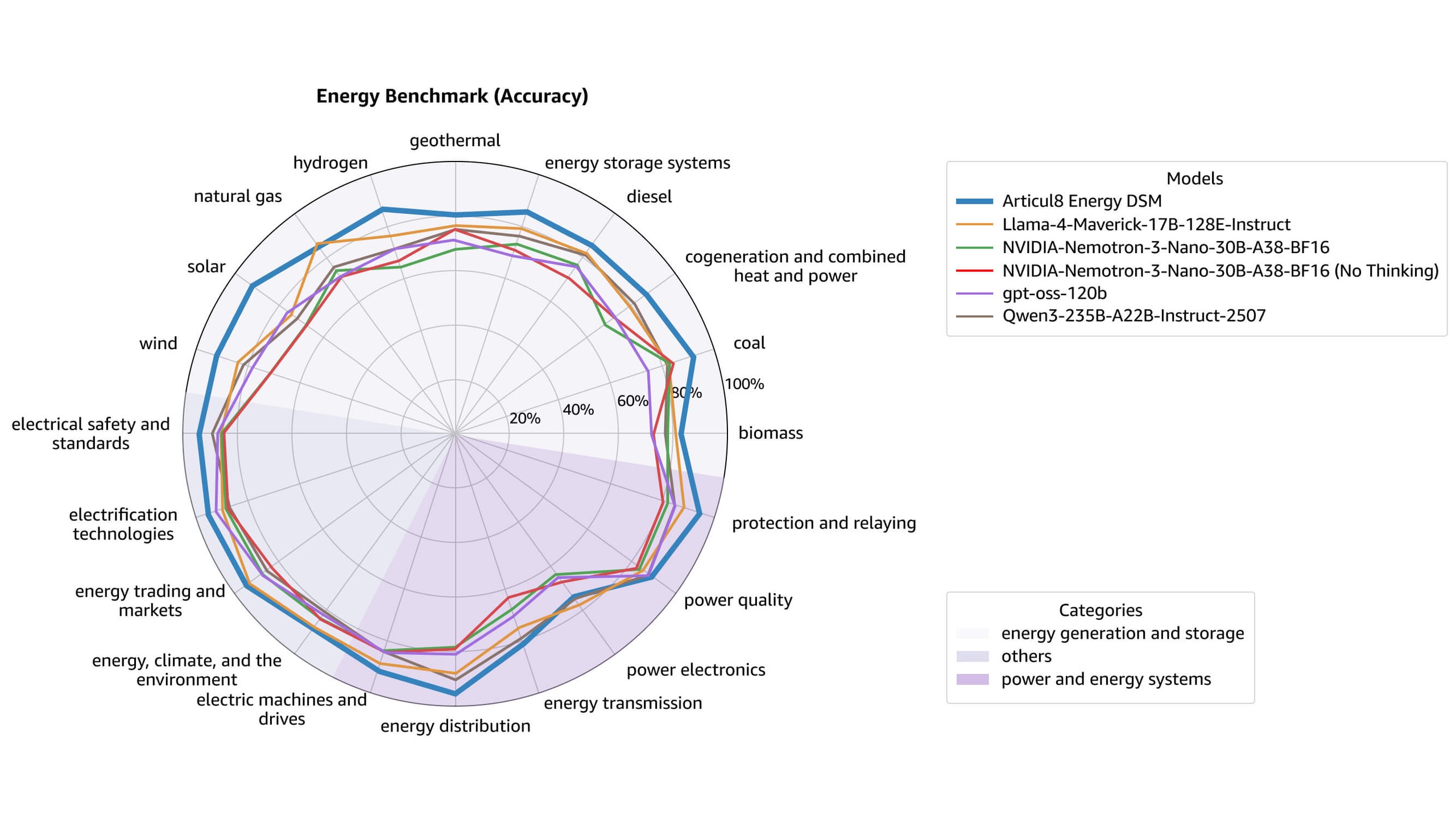

Dengan merancang platformnya di AWS menggunakan Meta Llama, Articul8 secara fundamental mendefinisikan ulang plafon performa untuk AI generatif industri. Transisi ke arsitektur model khusus domain (DSM) memberikan lompatan besar dalam presisi teknis, terutama untuk sektor energi. Menurut tolok ukur energi perusahaan, Articul8 Energy DSM mencapai akurasi keseluruhan 88 persen, seperti yang ditunjukkan pada tabel di bawah ini. Angka berikut menggambarkan tolok ukur berdasarkan topik.

Dengan mendasarkan platform pada data teknis kepemilikan alih-alih rekayasa prompt sederhana, Articul8 memungkinkan pelanggannya untuk membangun keunggulan kompetitif jangka panjang yang dapat dipertahankan. Dampak operasional paling jelas dalam lingkungan manufaktur dan utilitas yang kompleks, alur kerja agentik khusus kini mengidentifikasi dan menyelesaikan kegagalan peralatan dengan kecepatan yang luar biasa. Dengan mentransformasi kekhususan teknis dari derau putih menjadi kecerdasan yang dapat ditindaklanjuti, platform ini memungkinkan fasilitas untuk kembali ke produksi dengan cepat, secara efektif memulihkan pendapatan yang sebelumnya hilang karena waktu henti.

Sinergi antara infrastruktur AWS dan densitas kecerdasan dari Llama juga memberikan stabilitas sistem yang penting. Articul8 berhasil meningkatkan keahlian domain sambil mempertahankan jumlah parameter yang ringkas, memungkinkan pelanggan untuk melakukan deployment AI tingkat ahli di Amazon VPC mereka sendiri tanpa melebihi anggaran perangkat keras yang ketat. Viana mencatat, “Fakta bahwa sistemnya kurang kompleks berarti sistemnya lebih stabil dan lebih dapat diandalkan. Anda tidak melihat kisah ini ketika Anda melihat tolok ukur, tetapi pelanggan kami melihatnya.” Membangun di atas fondasi yang andal ini lebih dari sekadar menyelesaikan inefisiensi operasional langsung; hal ini menyediakan kerangka kerja yang dapat diskalakan yang dibutuhkan bagi korporasi untuk bergerak menuju alur kerja agentik tingkat ahli yang sepenuhnya otonom di seluruh jaringan energi global. Siap untuk melatih serta melakukan deployment model dalam skala besar? Pelajari bagaimana Amazon SageMaker dan Amazon EC2 dapat membantu Anda membangun, melakukan iterasi, dan menjalankan beban kerja AI bahkan untuk lingkungan waktu nyata yang paling menuntut.

Bagaimana konten ini?