Wie war dieser Inhalt?

- Lernen

- Articul8 AI schließt die Lücke im Bereich der Branchenexpertise mit spezialisierten Llama-4-Modellen und einer auf Sicherheit ausgerichteten AWS-Architektur

Articul8 AI schließt die Lücke im Bereich der Branchenexpertise mit spezialisierten Llama-4-Modellen und einer auf Sicherheit ausgerichteten AWS-Architektur

Industrieunternehmen sind mit erheblichen finanziellen Risiken und betrieblichen Verzögerungen konfrontiert, wenn sie universelle KI-Modelle einsetzen, die spezialisierte technische Daten als „Weißes Geräusch“ behandeln. Diese Ansätze haben Schwierigkeiten, komplexe Maschinenprotokolle und Sensordaten zu interpretieren, was zu ungenauen Ursachenanalysen und verlängerten Ausfallzeiten führt. Um diesem Problem zu begegnen, hat Articul8 AI eine generative KI-Plattform für Unternehmen entwickelt, die auf spezialisierten Meta-Llama-Modellen basiert. In Zusammenarbeit mit Meta und Amazon Web Services (AWS) hat Articul8 domänenspezifische Modelle erstellt, die Anlagenausfälle mit einer Gesamtgenauigkeit von 88 Prozent erkennen – und damit die höchste domänenspezifische Intelligenzdichte bieten. Dies ermöglicht es führenden Industrieunternehmen, ihren Fokus von der manuellen Datenerfassung auf proaktive Risikominderung und schnellere Wartungslösungen zu verlagern.

Das Rauschen der Allzweck-KI durchbrechen

Articul8 AI bietet eine generative KI-Plattform für Unternehmen, die es Branchen wie der Energie- und Fertigungsindustrie ermöglicht, Anwendungen zu entwickeln, die weit über einfache Chatbots hinausgehen. In diesen Bereichen stoßen Allzweckmodelle oft an ihre Grenzen, da ihnen das erforderliche fundierte technische Fachwissen fehlt, um komplexe Datensätze wie Maschinenprotokolle und Sensordaten aus der Fertigung zu interpretieren. Beispielsweise muss ein Modell in der Energieerzeugung und im Speicher in der Lage sein, zwischen hochspezialisierten technischen Nuancen zu unterscheiden, um bei Konstruktionsproblemen zu helfen oder kritische Wartungsausfälle zu planen. Für einen Laien mögen diese technischen Besonderheiten wie ein Geräusch erscheinen, doch für einen Ingenieur macht die Unfähigkeit eines Modells, diese Details zu erfassen, die Ergebnisse für die hochriskante Ursachenanalyse unzuverlässig.

Die Auswirkungen dieser Kompetenzlücke zeigen sich in massiven finanziellen Verlusten und einem Mangel an Wettbewerbsvorteilen. In der Fertigung führen Anlagenausfälle unmittelbar zu kostspieligen Produktionsausfällen; wie Felipe Viana, Leiter der angewandten Forschung bei Articul8, erklärt: „Wenn eine Anlage nicht produziert, verdient sie im Grunde genommen kein Geld. Die Anlage schneller wieder in Betrieb zu nehmen, ist nicht nur ein technisches Ziel – es führt direkt zu wiedergewonnenen Einnahmen.“ Über diese unmittelbaren Betriebskosten hinaus stehen Unternehmen, die sich ausschließlich auf Standardmodelle verlassen, vor einem langfristigen Problem der Wettbewerbsfähigkeit. Wenn jedes Versorgungsunternehmen dasselbe allgemeine Modell verwendet, besteht ihr einziges Unterscheidungsmerkmal im Prompt-Engineering – eine oberflächliche Barriere, die ihre geschützten Daten weder schützt noch nutzt.

Über diese strategischen Hürden hinaus stehen Industrieunternehmen vor dem kritischen Spannungsfeld zwischen der Intelligenzdichte – also der Rechenleistung eines Modells im Verhältnis zu seiner Größe – und infrastrukturellen Einschränkungen. Um eine Leistung auf Expertenniveau zu erzielen, waren Unternehmen bislang gezwungen, ihre Rechenkapazitäten unbegrenzt zu skalieren, was schnell zu unerschwinglichen Kosten führt. Zudem verlangen viele Kunden, dass Anwendungen vollständig isoliert oder in streng kontrollierten virtuellen privaten Clouds (VPCs) bereitgestellt werden, um die Sicherheit zu gewährleisten. Dies führt zu einem risikoreichen Kompromiss: Unternehmen benötigen eine Lösung mit ausreichender Intelligenzdichte, um komplexe, auf Expertenniveau angesiedelte agentische Workflows zu bewältigen, die jedoch gleichzeitig effizient genug ist, um in einen Hardware-Fußabdruck zu passen, der mit ihren bestehenden Budgets vereinbar ist.

Entwicklung spezialisierter industrieller KI mit Meta Llama 4 auf Amazon SageMaker HyperPod

Um die Lücke zwischen der reinen Infrastruktur und Unternehmensanwendungen zu schließen, hat Articul8 eine Plattform entwickelt, die breit angelegte Modelle in spezialisierte, leistungsstarke Assets umwandelt. Im Mittelpunkt dieser Strategie steht das firmeneigene ModelMesh – eine hochentwickelte Engine für agentenbasiertes Schlussfolgern, die als funktionaler Kern für Unternehmens-KI dient. Articul8 nutzte AWS zur Bereitstellung dieser Plattform und setzte Amazon SageMaker HyperPod ein, um komplexe, verteilte Trainings-Workloads mit der für groß angelegte industrielle Modelle erforderlichen granularen Flexibilität zu verwalten. Bei der Nutzung sowohl der Slurm- als auch der Amazon-Elastic-Kubernetes-Service-(Amazon EKS)-Version von HyperPod führt das angewandte Forschungsteam von Articul8 ein kontinuierliches Vor-Training an Meta Llama-4-Maverick-Basismodellen durch. Dieser Prozess speist domänenspezifisches Wissen – das aus einer kuratierten Mischung aus technischen und wissenschaftlichen Korpora stammt – direkt in die Modellarchitektur ein. Anschließend betteibt Articul8 eine Feinabstimmung dieser Modelle durch einen iterativen Zyklus aus überwachtem Optimieren und verstärktem Lernen, um eine Schlussfolgerungsfähigkeit auf Expertenniveau sicherzustellen. Zur Ausführung dieses intensiven Trainings für Branchen wie Energie und Fertigung setzt Articul8 auf Amazon-Elastic-Compute-Cloud (Amazon Articul8)-Instances, die während der gesamten Pipeline eine hohe Leistung und Datenintegrität gewährleisten.

Articul8 hat Meta Llama als Kern dieser Engine ausgewählt, da es das erste stabile Open-Source-Framework darstellt, das in der Lage ist, multimodale Eingaben – wie CAD-Zeichnungen und Sensorprotokolle – mit anspruchsvollen agentischen Text-Workloads zu verknüpfen. Diese hohe Intelligenzdichte ermöglicht es Articul8, Erkenntnisse auf Expertenniveau zu liefern und gleichzeitig die Anzahl der Parameter gering zu halten. Dies ist eine entscheidende Voraussetzung für Industriekunden, die mit strengen Hardware-Budgets arbeiten und sich den Betrieb massiver Allzweckmodelle nicht leisten können. Viana merkt an: „Vor Llama mussten wir separate, fragmentierte Modelle für Text und Bildverarbeitung koordinieren. Llama war die erste solide Grundlage, die es uns ermöglichte, ein einziges, einheitliches System aufzubauen, das sowohl multimodale Anwendungen als auch komplexe Agent-Workflows gleichzeitig beherrscht.“

Durch die Bereitstellung in AWS kann Articul8 eine Architektur anbieten, bei der Sicherheit an erster Stelle steht und die den strengen Anforderungen regulierter Branchen gerecht wird. Da viele Kunden aus den Bereichen Energieversorgung und Fertigung eine strenge Kontrolle über ihre Umgebungen aufrechterhalten müssen, nutzt Articul8 die Amazon Virtual Private Cloud (VPC), um seine Plattform innerhalb der eigenen sicheren Infrastruktur des Kunden zu hosten. Die Entscheidung für diese Bereitstellung trägt dazu bei, zu verifizieren, dass die geschützten Daten unter den eigenen Sicherheitsprotokollen geschützt bleiben, während gleichzeitig die Skalierbarkeit der Cloud genutzt wird. Eine enge technische Zusammenarbeit mit AWS hat diese Architektur weiter verfeinert und Articul8 umfassenden Support sowie frühzeitigen Zugang zu Infrastrukturoptimierungen geboten, die den Übergang vom Prototyp zur Produktion beschleunigten. Letztendlich bietet die Synergie zwischen der AWS-Infrastruktur und den Open-Weight-Modellen von Meta eine zuverlässige, kosteneffiziente Alternative zu generischen Frontier-Modellen und eröffnet Branchenführern einen spezialisierten Weg zu produktionsreifer KI.

Sicherstellung von Spitzenpräzision auf dem Stand der Technik und Zuverlässigkeit auf Industriestandard

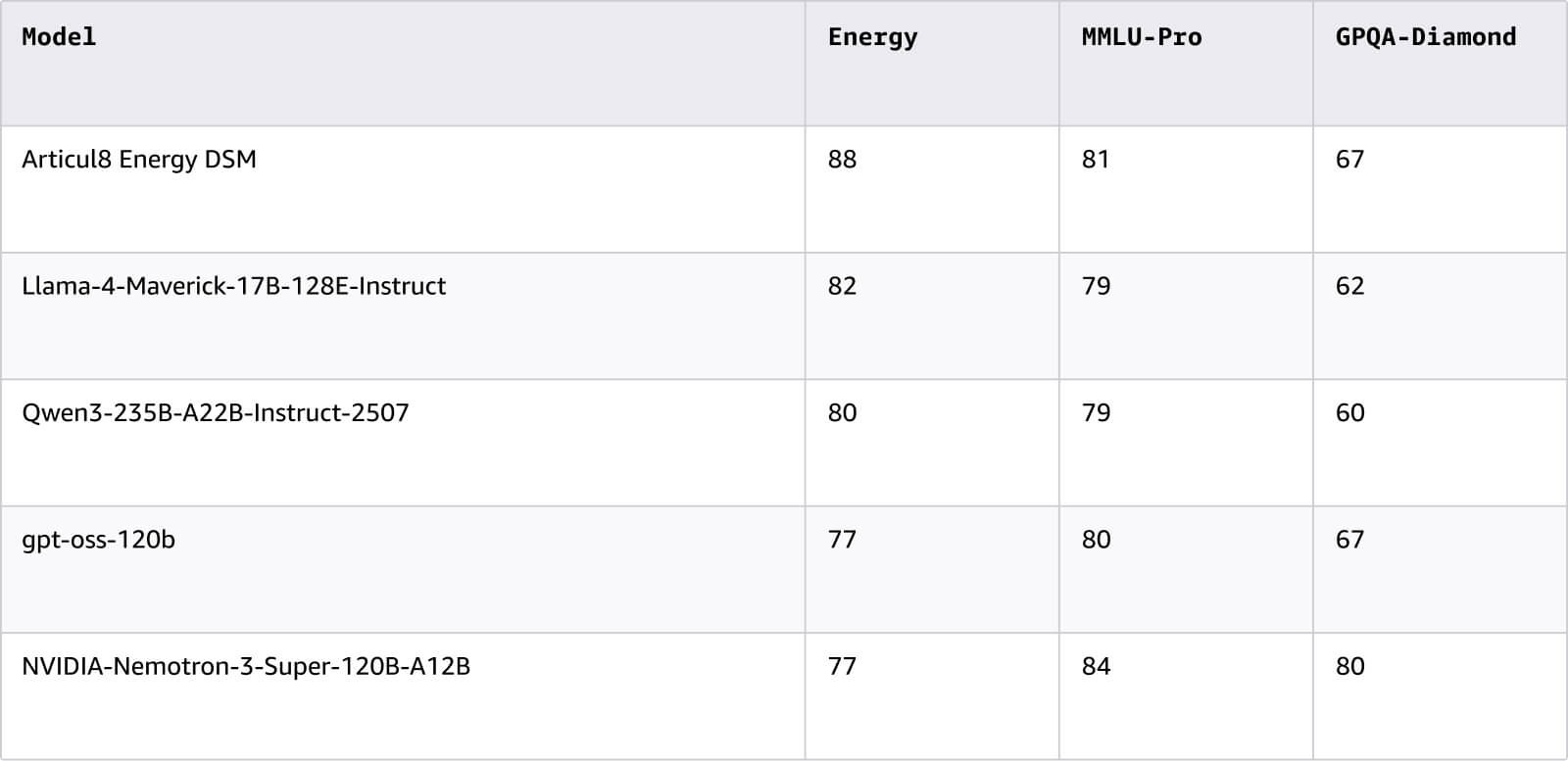

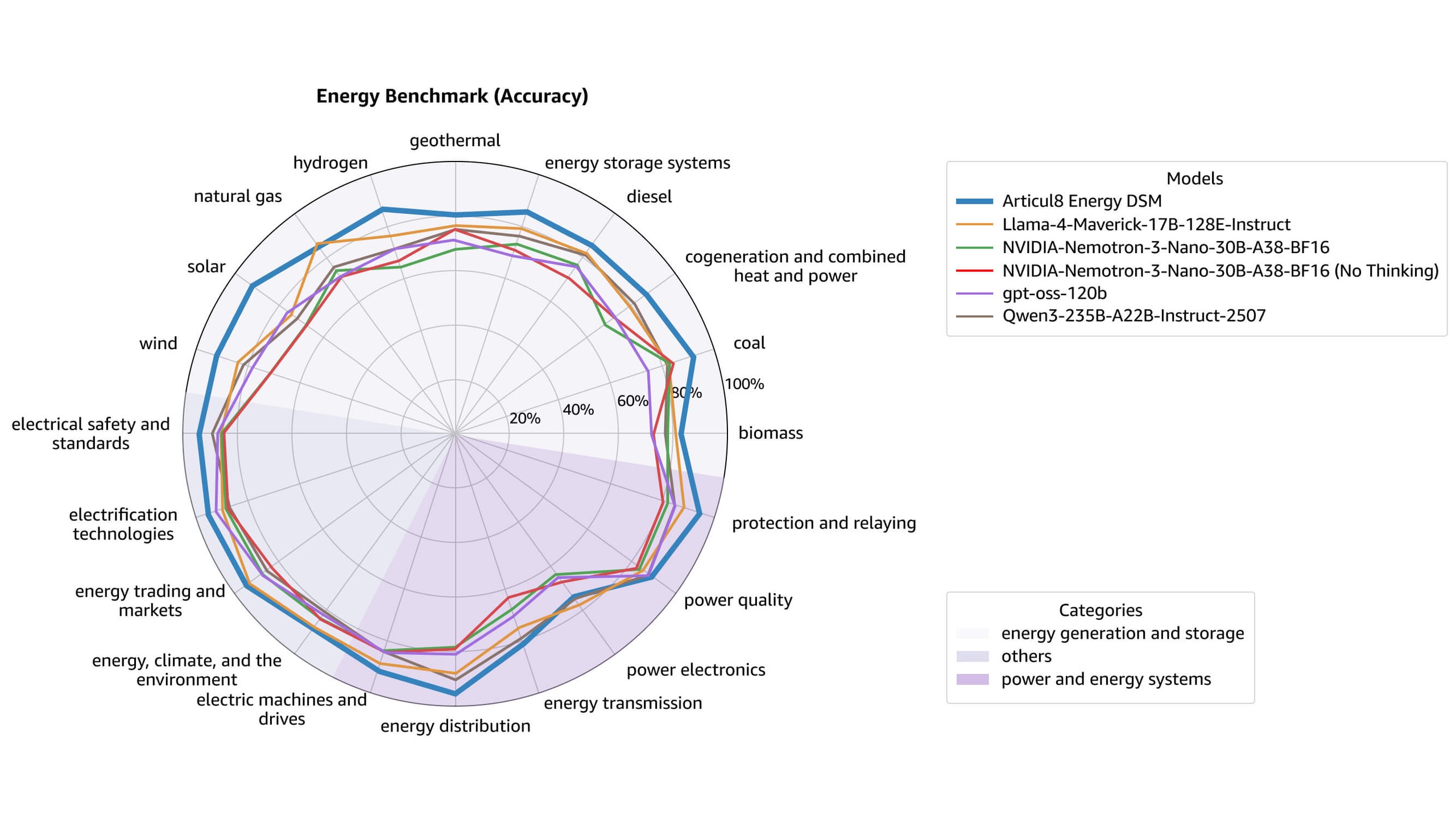

Durch die Entwicklung seiner Plattform in AWS mit Meta Llama hat Articul8 die Leistungsgrenze für generative KI im industriellen Bereich grundlegend neu definiert. Der Übergang zu einer domänenspezifischen Modellarchitektur (DSM) brachte einen enormen Sprung in der technischen Präzision mit sich, insbesondere für den Energiesektor. Laut den Energiebewertungen des Unternehmens erreichte das Articul8 Energy DSM eine Gesamtgenauigkeit von 88 Prozent, wie aus der nachstehenden Tabelle hervorgeht. Die folgende Abbildung veranschaulicht die Bewertung nach Themenbereichen.

Indem die Plattform auf geschützten technischen Daten statt auf einfachem Prompt-Engineering basiert, ermöglicht Articul8 seinen Kunden den Aufbau eines nachhaltigen, langfristigen Wettbewerbsvorteils. Die betrieblichen Auswirkungen zeigen sich am deutlichsten in komplexen Fertigungs- und Versorgungsumgebungen, wo spezialisierte, agentenbasierte Workflows nun Anlagenausfälle mit beispielloser Geschwindigkeit erkennen und beheben. Indem die Plattform technische Details aus dem „weißen Geräusch“ in verwertbare Erkenntnisse umwandelt, ermöglicht sie es den Betrieben, die Produktion rasch wieder aufzunehmen und so Einnahmen, die zuvor durch Ausfallzeiten verloren gingen, effektiv zurückzugewinnen.

Die Synergie zwischen der AWS-Infrastruktur und der hohen Intelligenzdichte von Llama sorgte zudem für entscheidende Systemstabilität. Articul8 gelang es, das Fachwissen zu erweitern und gleichzeitig die Anzahl der Parameter gering zu halten, sodass Kunden KI auf Expertenniveau in ihrer eigenen Amazon VPC bereitstellen können, ohne strenge Hardware-Budgets zu überschreiten. Viana merkt an: „Die geringere Komplexität des Systems bedeutet, dass es stabiler und zuverlässiger ist. In Benchmarks sind solche Aspekte nicht zu erkennen, aber unsere Kunden nehmen sie wahr.“ Auf dieser zuverlässigen Grundlage aufzubauen, löst nicht nur unmittelbare betriebliche Ineffizienzen, sondern bietet auch das skalierbare Framework, das Unternehmen benötigen, um zu vollständig autonomen, agentenbasierten Workflows auf Expertenniveau im globalen Energienetz überzugehen. Sind Sie bereit, Modelle in großem Maßstab zu trainieren und zur Bereitstellung zu nutzen? Erfahren Sie, wie Amazon SageMaker und Amazon EC2 Ihnen helfen können, KI-Workloads selbst für die anspruchsvollsten Echtzeitumgebungen zu erstellen, zu iterieren und auszuführen.

Wie war dieser Inhalt?