このコンテンツはいかがでしたか?

- 学ぶ

- Articul8 AI は、特化型の Llama 4 モデルとセキュリティを最優先した AWS アーキテクチャにより、産業分野における専門知識のギャップを埋めます

Articul8 AI は、特化型の Llama 4 モデルとセキュリティを最優先した AWS アーキテクチャにより、産業分野における専門知識のギャップを埋めます

産業企業は、専門的な技術データを単なるノイズとして扱う汎用 AI モデルを使用する場合、重大な財務リスクや業務の遅延に直面します。こうしたアプローチでは、複雑な機械ログやセンサーデータの解釈が困難であり、その結果、根本原因の分析が不正確になったり、ダウンタイムが長期化したりする原因となります。この課題に対処するため、Articul8 AI は、専用の Meta Llama モデルを活用したエンタープライズグレードの生成 AI プラットフォームを開発しました。Meta およびAmazon Web Services(AWS)と連携し、Articul8 は設備の故障を全体で 88% の精度で特定するドメイン特化型モデルを構築し、最高レベルのドメイン特化型インテリジェンス密度を実現しました。これにより、産業分野のリーダーは、手作業によるデータ収集から、予防的なリスク軽減や迅速なメンテナンス対応へと注力できるようになります。

汎用AIのホワイトノイズを打ち破る

Articul8 AI は、エネルギーや製造業などの業界が、単なるチャットボットをはるかに超えたアプリケーションを構築できる、エンタープライズグレードの生成 AI プラットフォームを提供しています。これらの分野では、汎用モデルは、製造現場からの機械ログやセンサーデータといった複雑なデータセットを解釈するために必要な高度な技術的専門知識を欠いているため、しばしば不十分です。例えば、発電や蓄電の分野では、設計上の課題の解決や重要なメンテナンス停止の計画立案を支援するために、モデルは高度に専門化された技術的なニュアンスを区別できなければなりません。専門家でない人にとっては、こうした技術的な細部は単なる雑音に過ぎないかもしれませんが、エンジニアにとっては、モデルがこれらの詳細を把握できない場合、重大なリスクを伴う根本原因分析において、その出力結果は信頼できないものになってしまいます。

この専門知識のギャップがもたらす影響は、莫大な経済的損失と競争上の差別化の欠如という形で現れます。製造業において、設備の故障は直接的に多額の生産停止コストにつながります。Articul8 の応用研究責任者であるフェリペ・ヴィアナ氏は次のように説明しています。「工場が生産を行っていない時、実質的に収益は生み出されていません。その施設をより早く稼働に戻すことは、単なる技術的な目標ではなく、そのまま収益の回復につながるのです。」こうした差し迫った運用コストに加え、既製のモデルにのみ依存している組織は、長期的な競争力の維持という課題に直面しています。もしすべての公益事業会社が同じ一般的なモデルを使用しているならば、その唯一の差別化要因は迅速なエンジニアリング対応に限られてしまいます。これは、自社の独自データを保護したり活用したりすることにはつながらない、浅い障壁に過ぎないのです。

こうした戦略的な障壁に加え、産業企業は、「インテリジェンス密度」(モデルのサイズに対する推論能力)とインフラの制約との間の重大なジレンマに直面しています。専門家レベルのパフォーマンスを実現するため、組織は従来、計算リソースを際限なく拡張せざるを得ず、その結果、コストがすぐに膨れ上がってしまっていました。さらに、多くの顧客はセキュリティを確保するため、アプリケーションを完全にエアギャップ化するか、厳重に管理された仮想プライベートクラウド(VPC)内に展開することを求めています。これにより、重大なトレードオフが生じます。企業には、複雑で専門家レベルの能動的なワークフローを処理できる十分なインテリジェンス密度を備えつつ、既存の予算に見合ったハードウェア環境に収まるほど効率的なソリューションが必要とされています。

Amazon SageMaker HyperPod 上で Meta Llama 4 を使用して、産業向け特化型 AI を構築する

インフラストラクチャとエンタープライズアプリケーションの間のギャップを埋めるため、Articul8 は汎用モデルを特化型の高性能アセットへと変換するプラットフォームを開発しました。この戦略の中核をなすのが、独自の「ModelMesh」です。これは、産業用 AI の機能的な中核となる推論エンジンとして機能する、高度なエージェント型推論エンジンです。Articul8 は、このプラットフォームの基盤として AWS を採用し、Amazon SageMaker HyperPod を活用して、大規模な産業用モデルに必要なきめ細かな柔軟性を備えた、複雑で分散型のトレーニングワークロードを管理しています。Articul8 の応用研究チームは、HyperPodのSlurm 版とAmazon Elastic Kubernetes Service (Amazon EKS) 版の両方を活用し、Meta Llama-4-Maverick ベースモデルに対して継続的な事前学習を行っています。このプロセスでは、厳選された技術・科学コーパスの組み合わせから得られたドメイン固有の知識を、モデルアーキテクチャに直接注入します。その後、Articul8 は、専門家レベルの推論を確実にするため、教師あり微調整と強化学習の反復ループを通じてこれらのモデルを精緻化します。エネルギーや製造などの分野におけるこの集中的なトレーニングを実行するため、Articul8 はAmazon Elastic Compute Cloud (Amazon EC2) インスタンスを活用しており、これによりパイプライン全体を通じて高いパフォーマンスとデータの整合性が維持されています。

Articul8 は、CAD 図面やセンサーログといったマルチモーダルな入力と、高度なエージェント型テキスト処理ワークロードを統合できる、初の安定したオープンソースフレームワークであるMeta Llamaを、このエンジンの中核として採用しました。この高い知能密度により、Articul8 はパラメータ数を抑えつつ、専門家レベルの洞察を提供することが可能になります。これは、大規模な汎用モデルを実行する余裕がなく、厳しいハードウェア予算の中で事業を展開する産業分野の顧客にとって、不可欠な要件です。Viana 氏は次のように述べています。「Llama が登場する前は、テキストとビジョン用に別々の断片的なモデルを調整する必要がありました。Llama は、マルチモーダルアプリケーションと複雑なエージェント型ワークフローの両方を同時に処理できる、単一の統合システムを構築するための、初めての確固たる基盤となりました。」

AWS への導入により、Articul8 は規制の厳しい業界の厳しい要件を満たす、セキュリティを最優先としたアーキテクチャを提供することが可能になります。多くの公益事業や製造業の顧客は、自社の環境に対して厳格な管理を維持する必要があるため、Articul8 はAmazon Virtual Private Cloud (Amazon VPC)を利用して、顧客自身のセキュアなインフラストラクチャ内にプラットフォームをホストしています。このデプロイモデルを採用することで、企業の独自データが自社のセキュリティプロトコル下で確実に保護されつつ、クラウドのスケールメリットも享受できることが保証されます。AWS との緊密な技術的連携により、このアーキテクチャはさらに洗練され、Articul8 は詳細なサポートとインフラ最適化への早期アクセスを得ることができました。これにより、プロトタイプから本番環境への移行が加速されました。最終的に、AWS インフラと Meta のオープンウェイトモデルとの相乗効果により、汎用的なフロンティアモデルに代わる、信頼性が高くコスト効率の良い選択肢が提供され、産業のリーダー企業に、実用レベルの AI を実現するための専門的な道筋が示されています。

最先端(SOTA)の精度と産業用レベルの信頼性を確立する

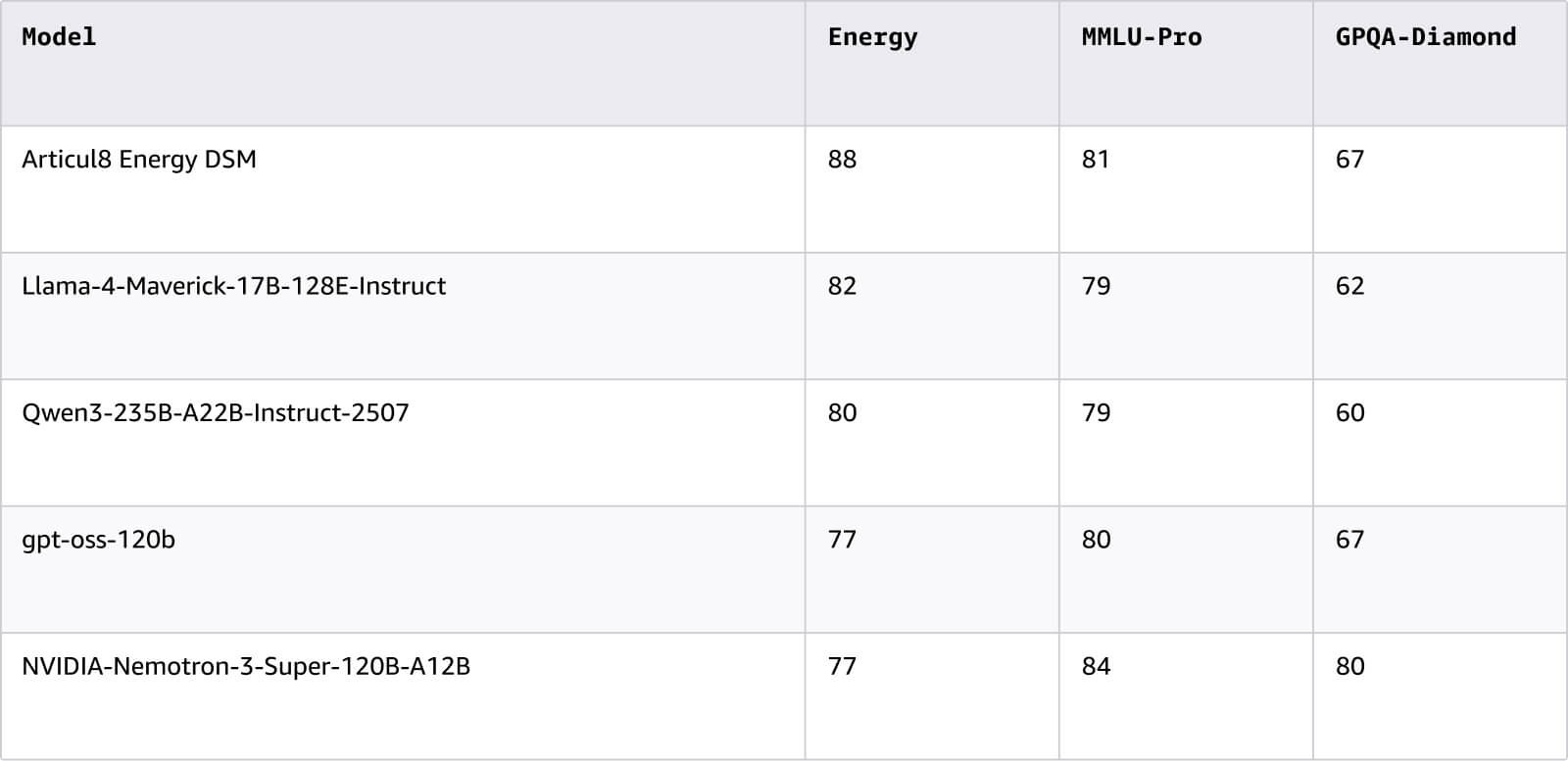

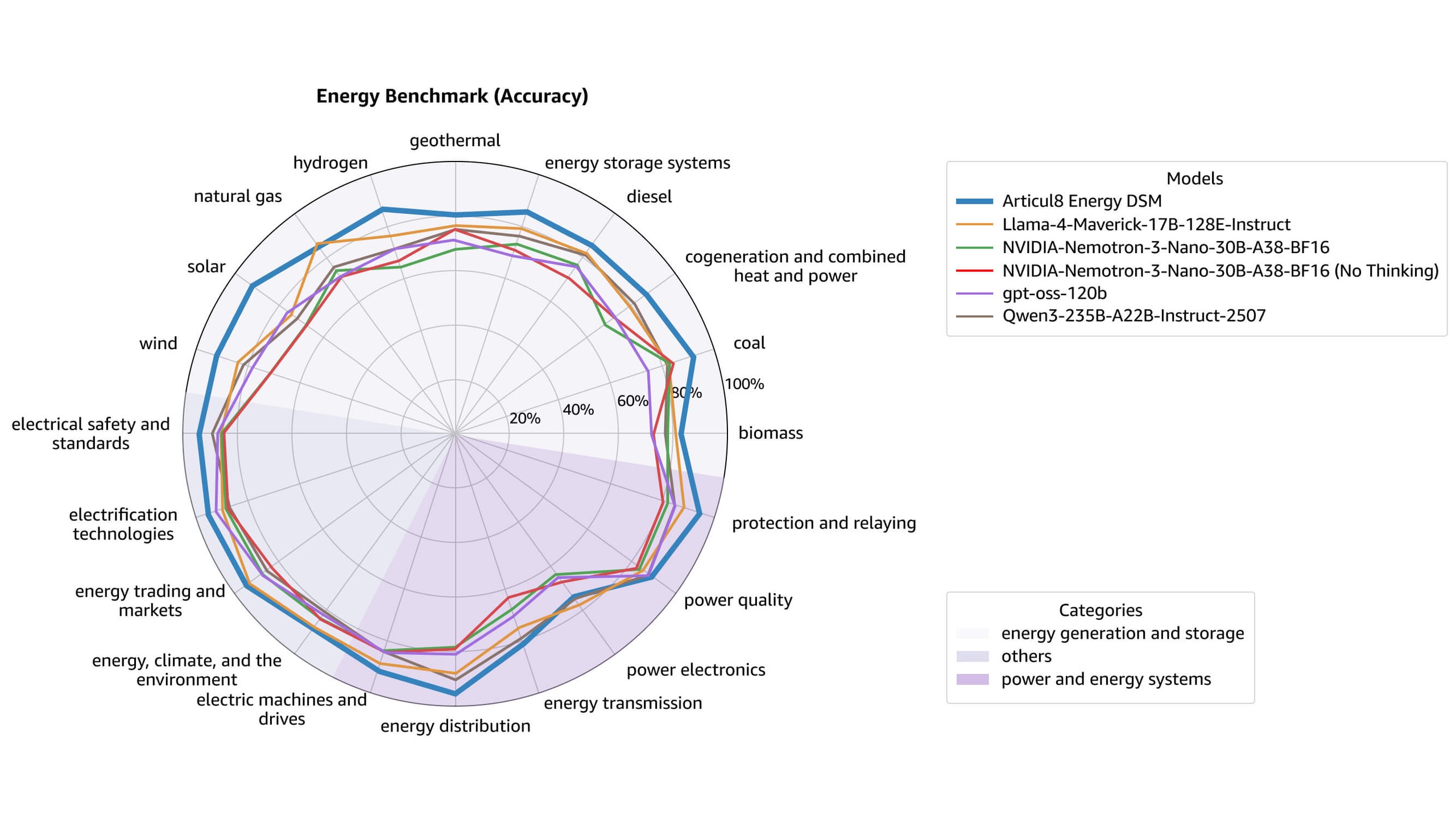

Articul8 は、Meta Llama を活用して AWS 上にプラットフォームを構築することで、産業用生成 AI の性能限界を根本的に再定義しました。ドメイン特化型モデル(DSM)アーキテクチャへの移行により、特にエネルギー分野において技術的な精度が飛躍的に向上しました。同社のエネルギー分野におけるベンチマークによると、Articul8 Energy DSM は、下表に示す通り、全体で 88% の精度を達成しました。次の図は、トピック別のベンチマーク結果を示しています。

Articul8 は、単なるプロンプトエンジニアリングではなく、独自の技術データに基づいたプラットフォームを提供することで、顧客が確固たる長期的な競争優位性を確立することを可能にします。その運用上の効果は、複雑な製造現場や公益事業環境において最も顕著であり、専門的なエージェント型ワークフローにより、機器の故障をこれまでにない速さで特定・解決できるようになりました。技術的な詳細情報を単なる雑音から実用的な知見へと変換することで、このプラットフォームは施設の迅速な生産再開を可能にし、ダウンタイムによって失われていた収益を効果的に回復させます。

AWS のインフラと Llama の知能密度との相乗効果により、システムの安定性も大幅に向上しました。Articul8 は、パラメータ数をコンパクトに保ちつつドメイン専門知識を強化することに成功し、顧客は厳しいハードウェア予算を超過することなく、自社の Amazon VPC にエキスパートレベルの AI を導入できるようになりました。ヴィアナ氏は次のように述べています。「システムの複雑さが低減されたということは、システムがより安定し、信頼性が高まったことを意味します。ベンチマークを見てもこうした事例は目立ちませんが、当社の顧客は実感しています。」 この信頼性の高い基盤を構築することは、当面の運用上の非効率性を解決するだけにとどまりません。それは、企業が世界的なエネルギーグリッド全体で、完全に自律したエキスパートレベルのエージェント型ワークフローへと移行するために必要な、スケーラブルなフレームワークを提供するものです。モデルの大規模なトレーニングとデプロイの準備はできていますか?Amazon SageMakerとAmazon EC2 が、最も要求の厳しいリアルタイム環境においても、AI ワークロードの構築、反復、実行をどのように支援できるかをご覧ください。

このコンテンツはいかがでしたか?